Quando basta uno Zoom-Out per cambiare (o raccontare meglio) la storia di una fotografia

Midjourney ha lanciato in settimana la sua versione V5.2, con diverse migliorie e introducendo la funzione di Zoom-Out, che è molto di più di un semplice ingrandimento dello sfondo...

Qualche giorno fa è uscita la versione V5.2 di Midjourney, il più evoluto sistema di generazione di immagini AI, introducendo delle caratteristiche davvero entusiasmanti per la fotografia e per l’immagine, anche se non siamo ancora al passaggio di generazione (da V5 a V6) che si attende per luglio, a pochissimi mesi, nemmeno 3, dallo sconvolgente step della V5.0 che ha trasformato la resa illustrativa della V4 in “vere” fotografie, e si va avanti, correndo, verso un orizzonte che davvero è senza limiti.

Oltre ad un aumento del dettaglio consistente, che di colpo fa sembrare “sfuocate” quelle immagini appena realizzate anche solo pochi giorni fa che sembravano eccellenti, c’è una funzione, denominata solitamente “outpainting”, che “allarga” la scena di una immagine, inventando una possibile continuità. Funzione già presente in altre piattaforme (Stable Diffusion, Dall-E, Adobe Firefly), non era ancora comparsa su Midjourney, anche per una questione di maggiore complessità della gestione di queste operazioni di “post-produzione” di quest’ultima piattaforma che - ancora al momento, si vedrà in futuro - opera su server Discord e non sul web (riducendo la flessibilità delle operazioni che prevedono per esempio selezioni e inquadrature parziali).

Proprio per questa caratteristica (più che per i “limiti”, perché lavorare su Discord ha una serie di vantaggi, alcuni poco compresi ma che potrebbero diventare particolarmente pressanti nel futuro e anche nel presente, temi di cui parleremo presto), l’outpainting di Midjourney è diverso, ma tutto, in Midjourney, è in effetti “diverso” e molto più fotografico a nostro giudizio. La funzione l’hanno chiamata Zoom Out, ed è esattamente quello che fa, anche dal punto di vista visuale rispetto al termine fotografico: non aggiunge semplicemente altri elementi sullo sfondo, ma “riscatta” la stessa identica immagine con una “focale” più grandangolare rispetto allo “scatto” di partenza. La resa, dal punto di vista concreto, è molto diversa, come detto, rispetto al tradizionale outpainting e permette di “inventare” nuove storie: è questo che troviamo affascinante. Per capire come “estremo” vi mostriamo questo video [LINK], che mostra quanto si possa costruire una storia dal cambio di “inquadratura”, ma al tempo stesso questo ci permette di mettere a fuoco una tematica spesso poco considerata (o non abbastanza considerata) che è il quanto, dal punto di vista dello storytelling, può cambiare la percezione della storia che sta dietro un’immagine, semplicemente facendo uno “zoom out”.

Un primo piano dice molte cose di una “storia”, ma allontanandosi, inquadrando una scena più ampia, si può scoprire molto di più, si può aprire un mondo. Lo abbiamo testato, facendo una semplice prova, riprendendo un’immagine che avevamo prodotto un paio di mesi fa per questo numero del Sunday Jumper, sia per verificare la resa della versione V5.2 rispetto alla precedente V5.1, sia perché quella scena poteva darci un’interpretazione diversa o più completa rispetto al primo piano. In effetti è successo proprio così, guardate, quella qui sotto è la prima immagine:

Poi abbiamo fatto un ingrandimento (zoom-out) del 2x, con questo risultato:

Dove sono apparse delle tende, dal “nulla”, anche se non è esattamente un nulla, perché la nostra immagine aveva previsto nel suo prompt iniziale che ci fosse un’ambientazione cupa. Abbiamo allargato ancora del 2x ed ecco la scena ancora più angosciante, perché quello che ci mostra è un accampamento ben più ampio di quello che poteva sembrare:

Infine abbiamo fatto un ulteriore Zoom-out, ottenendo questo risultato:

E ci siamo fermati, perché la mente ha cominciato a riempirsi di altre idee e di pensieri, facendoci arrivare alla conclusione che oggi abbiamo uno strumento in più per “raccontare storie”, che anche se non corrispondono necessariamente alla verità, come abbiamo detto sullo scorso numero del Sunday Jumper (QUI), ci permettono di usare una narrazione sempre più vicina al cinema, mettendo a fuoco sempre meglio un messaggio che vince sulla veridicità a tutti i costi. Al tempo stesso abbiamo messo in luce, nella nostra mente (anche nella vostra?), il limite alla “veridicità” della stessa fotografia, perché se questa fosse stata una situazione “vera”, lo sguardo, il viso e l’espressione della ragazzina potevano, con il taglio stretto, essere interpretati in modo molto diverso dalla realtà che avrebbe avuto attorno. Ci è venuto in mente la strada esplorata da BeReal che propone, ad un orario prestabilito, di dover scattare in pochi minuti dalla “richiesta” dell’app, una doppia foto, una del viso e l’altra dell’ambiente, per garantire e pubblicare sul social la “vera-realtà” della situazione, per combattere quella che invece è la falsità costruita su e per Instagram. Abbiamo pensato che sarebbe bello che, per ogni immagine o servizio di fotoreportage, venisse richiesto e proposto dal fotografo un corollario di immagini “di ambiente”, di “zoom out” oltre che per garantire la veridicità assoluta (vero o fake), anche per comprendere cosa il fotografo ha effettivamente selezionato da quella realtà, creando la “sua” verità. Potrebbe essere una proposta interessante…

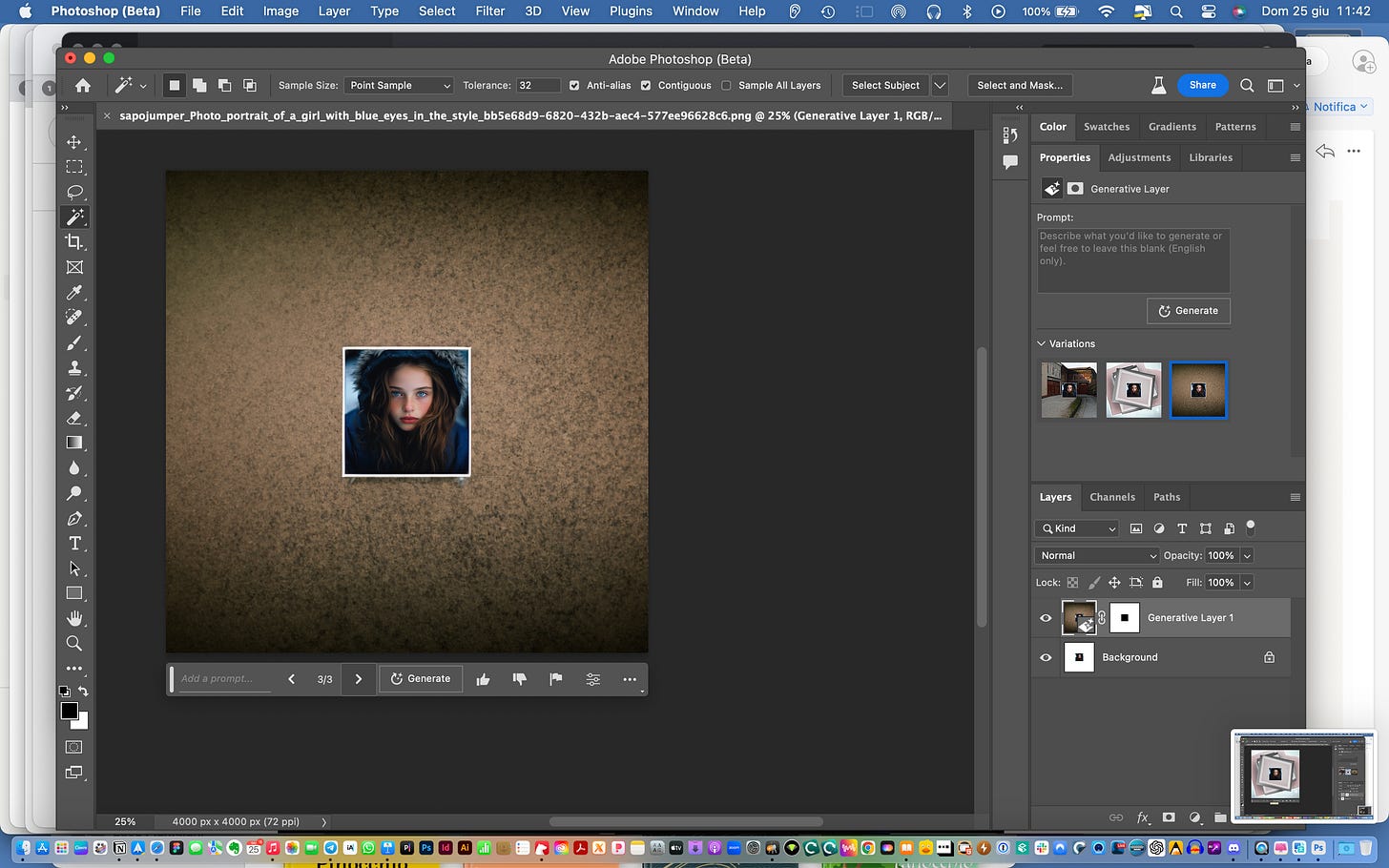

L’altra cosa che abbiamo sperimentato e scoperto è che non tutti i tool di outpainting sono uguali. Ovvio, direte voi, ma il dettaglio in questo caso apre un ulteriore pensiero: usando strumenti diversi di outpainting, si attendono non solo risultati diversi, ma anche interpretazioni diverse e, di conseguenza, storie diverse, con le quali si può lavorare per ottimizzare il messaggio e gli obiettivi. La stessa immagine, per esempio, l’abbiamo data in pasto a Photoshop, che nella sua versione beta consente proprio la generazione di sfondi con la tecnica dell’outpainting, e prima vi facciamo sorridere perché usando la stessa logica di “allargamento” su tutti i lati, il risultato è stato deludente (come capita quasi sempre, vero che siamo in beta però… un po’ deludente):

e poi, operando di fino e quindi ingrandendo un’area alla volta, pur accettando tempi decisamente più lunghi di produzione rispetto a Midjourney, abbiamo ottenuto un risultato che si è facilitato la vita allargando il fondo sfuocato e… via così:

Il risultato è forse deludente rispetto al potenziale narrativo della versione dello zoom out di Midjourney, ma offre comunque un’altra interpretazione, totalmente diversa dal punto di vista espressivo.

Come vedete, questi tool aprono percorsi sui quali riflettere, abbiamo visto che un pur “piccolo” aggiornamento ci apre un orizzonte, ci permette di confrontare questo approccio “generativo” con l’etica e la scelta narrativa e creativa dell’inquadratura in una immagine fotografica che riprende una “scena vera”, e ci permette di valutare che a parità di “tecnica di base”, si possono usare e ottenere ingredienti visuali e narrativi diversi.

Di tutto questo, con approfondimenti profondi, concreti, sia dal punto di vista tecnico che da quello del come ridisegnare la professione e la creatività di chi realizza immagini, parleremo sulla nostra rivista AiWay, sempre più vicina all’uscita. Preparatevi, perché l’attesa è quasi finita e vi vogliamo tutti accanto e insieme a noi per il suo lancio!

Se hai trovato interessante questo articolo, condividilo con chi vuoi, segnalalo sui tuoi canali social e consiglia a tutti di iscriversi a questa newsletter!